Künstliche Intelligenz hält Einzug in den Arbeitsalltag – oft schneller, als Unternehmen reagieren können. Eine AI Policy schafft den Rahmen für den sicheren, rechtskonformen und effizienten Einsatz von KI-Systemen. Doch viele AI Policies greifen zu kurz, weil sie das falsche Problem adressieren. Dieser Artikel nennt die wichtigsten Bausteine.

- Hersteller, die KI in ihren regulatorischen Prozessen verwenden, sollten eine AI Policy definieren.

- Sie sollten dabei Datenschutz und IP-Schutz nicht verwechseln. Meistens geht es um das letztere.

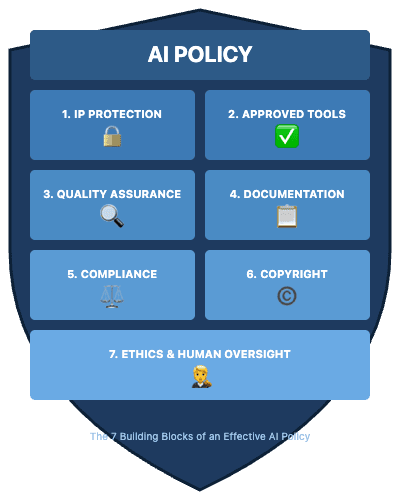

- Die AI Policy sollte sieben Bausteine umfassen.

Das große Missverständnis: Es geht nicht um Datenschutz

Fragen Sie in Unternehmen nach den größten Bedenken beim KI-Einsatz, lautet die Antwort meist: Datenschutz. Doch in den meisten Anwendungsfällen geht es gar nicht um den Schutz personenbezogener Daten im Sinne der DSGVO.

Es geht um IP-Schutz – den Schutz Ihrer Kronjuwelen: Entwicklungsdokumente, Konstruktionsdaten, Geschäftsgeheimnisse. Das Risiko ist real: Vertrauliche Informationen, die in ein KI-System eingegeben werden, könnten für das Training verwendet werden – und über Umwege bei Wettbewerbern landen.

Eine wirksame AI Policy muss daher beim IP-Schutz ansetzen, nicht beim Datenschutz.

Die 7 Bausteine einer wirksamen AI Policy

1. IP-Schutz

- Vertrauliche Informationen nur in KI-Systeme eingeben, die das Training mit Kundendaten vertraglich ausschließen

- Alternative: Selbst gehostete Modelle unter eigener Kontrolle

- Klare Definition, welche Informationen als vertraulich gelten

2. Zugelassene Tools

- Whitelist freigegebener KI-Tools führen

- Nutzung nicht genehmigter Tools („Schatten-KI“) untersagen

- Freigabeprozess für neue Tools definieren

Die meisten Hersteller führen bereits eine Liste mit IT-Systemen, Werkzeugen und/oder Messmitteln, die um die KI-Tools ergänzt werden können.

3. Qualitätssicherung

- KI-generierte Inhalte vor Verwendung verifizieren

- Besondere Sorgfalt bei regulatorischen Dokumenten

- Verantwortung bleibt beim Menschen – Halluzinationen entbinden nicht von der Prüfpflicht

Wenn die KI-Tools im Rahmen der QM-Prozesse verwendet werden (was fast immer der Fall ist), dann zählen diese als computerisierte Systeme und müssen validiert werden.

Lesen Sie hier mehr über die Computerized Systems Validation.

4. Transparenz und Dokumentation

- Kennzeichnung KI-generierter Inhalte regeln

- Prompts und verwendete Modelle bei relevanten Ergebnissen dokumentieren

- Rückverfolgbarkeit für Audits sicherstellen

Prompts und strukturierte Daten sind die neuen Templates. Entsprechend unterliegen sie den gleichen Anforderungen an die Dokumentenlenkung.

5. Compliance

- Eingesetzte KI-Systeme nach Risikoklassen bewerten

- Bei Hochrisiko-Anwendungen (gemäß AI Act): erweiterte Anforderungen beachten

- Schulungspflicht (AI Literacy) für Mitarbeitende umsetzen

Die meisten KI-Tools zählen nicht als Hochrisiko-Produkte gemäß AI Act. Aber die Anforderungen von MDR und ISO 13485 greifen dennoch. Dazu zählen die Anforderungen an

- Definition und Nachweis von Kompetenzen (sogar pro Entwicklungsprojekt)

- Computerized Systems Validation

6. Urheberrecht

- Nutzungsrechte an KI-generierten Ergebnissen klären

- Risiko von Urheberrechtsverletzungen beachten

- KI-Output ggf. als Entwurf behandeln, nicht als fertiges Werk

7. Ethik und menschliche Kontrolle

- Keine automatisierten Entscheidungen ohne menschliche Prüfung (im HR-Kontext beachten, dass sonst Hochrisiko-Systeme verwendet werden)

- Bewusstsein für Bias in KI-Ergebnissen schaffen

- Grundsatz: KI unterstützt – Menschen entscheiden

Fazit: AI Policy richtig priorisieren

Eine AI Policy ist kein Bürokratiemonster, sondern ein Schutzschild – insbesondere für Ihr geistiges Eigentum. Wer beim Datenschutz beginnt, setzt an der falschen Stelle an. Der Kern einer wirksamen AI Policy ist der IP-Schutz, flankiert von klaren Regeln zu Qualität, Transparenz und Compliance.

Die gute Nachricht: Mit den sieben Bausteinen oben haben Sie eine solide Grundlage. Ihre AI Policy muss nicht perfekt sein – aber sie muss existieren.

Das Johner Institut unterstützt Medizinproduktehersteller und IVD-Hersteller bei der Entwicklung regulatorischer Vorgaben – auch beim Thema KI. Für Unternehmen, die KI in Medizinprodukten einsetzen, gelten zusätzliche Anforderungen, die über eine allgemeine AI Policy hinausgehen.